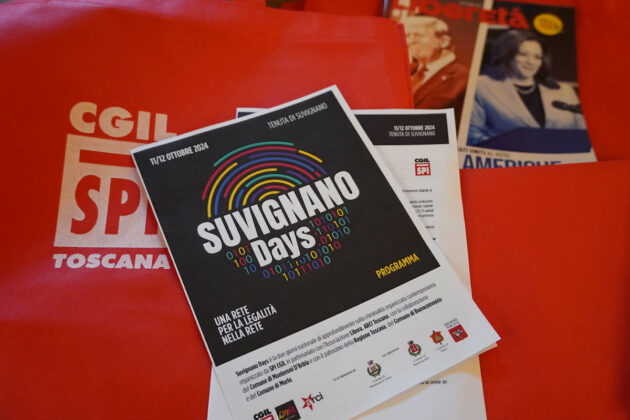

Si sono aperti oggi, 11 ottobre, nella Tenuta di Suvignano (Monteroni d’Arbia – Siena) i “Suvignano Days“, iniziativa promossa da SPI CGIL in collaborazione con l’Associazione Libera, ARCI Toscana, Comune di Monteroni d’Arbia e con il patrocinio di Regione Toscana, Comune di Buonconvento e Comune di Murlo. Al centro della prima giornata, aperta da Marco Tognetti,coordinatore del Progetto Legalità Digitale SPI CGIL, i temi delle nuove tecnologie, le opportunità e i rischi dell’intelligenza artificiale e la cybersicurezza.

“Secondo l’ultimo rapporto Digital 2024 redatto da We are social – ha ricordato Marco Tognetti coordinatore del Progetto Legalità Digitale SPI CGIL, aprendo a Suvignano i lavori della due giorni – il 73% degli italiani utilizza regolarmente almeno un social media, con un tempo di connessione ad internet in media giunto a ben 5 ore e 49 minuti. Da novembre 2022, cioè dal lancio della prima versione pubblica di Chatgpt, l’Intelligenza Artificiale (IA), o meglio software basati su quest’ultima, è entrata nel linguaggio, nell’immaginario e nella pratica lavorativa, di studio o divertimento di oltre il 50% degli italiani”.

“Anche le mafie hanno compreso le potenzialità del web e dell’inteIligenza artificiale come strumenti ulteriori per agire per i propri fini illegali – ha detto Giorgio Marasco, direttore di Scintille, collana di volumi pubblicata dalla Fondazione Scintille di futuro, che ha moderato il pomeriggio dell’11 ottobre -. Il crimine informatico genera a livello globale tre volte più guadagni rispetto al traffico di droga e soprattutto per le mafie comporta meno rischi”.

L’Italia è in 5^ posizione mondiale per il furto di account e-mail e al 18esimo posto per la sottrazione dei dati di carta di credito. Gli over 50 sono i più colpiti: è quanto emerge da una ricerca dell’Osservatorio Cyber di CRIF, illustrata a Suvignano da Beatrice Rubini, Executive Director CRIF. “Si corrono rischi nel condividere i dati in rete spontaneamente o perché si è vittime di attacchi di phishing – ha detto Rubini -. Una mole notevole di dati viene sottratta e circola nel dark web, dove i dati vengono scambiati e utilizzati per perpetrare frodi ai danni dei cittadini”. Dalla ricerca emerge che spesso le password rubate sono semplici e non sufficientemente sicure, per cui la raccomandazione è quella di utilizzare password complesse, con più fattori di autenticazione e diverse da account a account.

Giorgio Pedrazzi, HPC Data scientist Cineca si è soffermato sui diversi aspetti di carattere etico e legale che occorre considerare nel creare i modelli di intelligenza artificiale. “Nell’ambito dei large language models, modelli di carattere probabilistico che ‘imparano’ dai testi – evidenzia Pedrazzi – c’è il rischio che questi forniscano dei risultati distorti in base ai testi che hanno utilizzato per l’apprendimento e quindi diano risposte non veritiere o che non rispettano le norme etiche che si sta dando l’Unione europea. I risultati dell’intelligenza artificiale dipendono dal materiale su cui sono stati addestrati, inoltre c’è un aspetto riguardante il copyright nel senso che il materiale utilizzato deve essere di pubblico dominio o comprato dalle aziende che lo utilizzano”.

“Fortunatamente abbiamo avuto degli interventi legislativi posti in essere – ha detto Caterina Sganga, professoressa ordinaria della Scuola Superiore Sant’Anna -. È importantissimo che questa regolazione non resti una pietra miliare che terremo per vent’anni, ma che venga costantemente monitorata e adattata per essere sicuri che il diritto non arrivi troppo dopo la tecnologia”. Brando Benifei, europarlamentare, relatore del Regolamento europeo sull’intelligenza artificiale, ha inviato un videomessaggio ai partecipanti.